A cura di Peter Kirkup, Technical Solutions Manager EMEA.

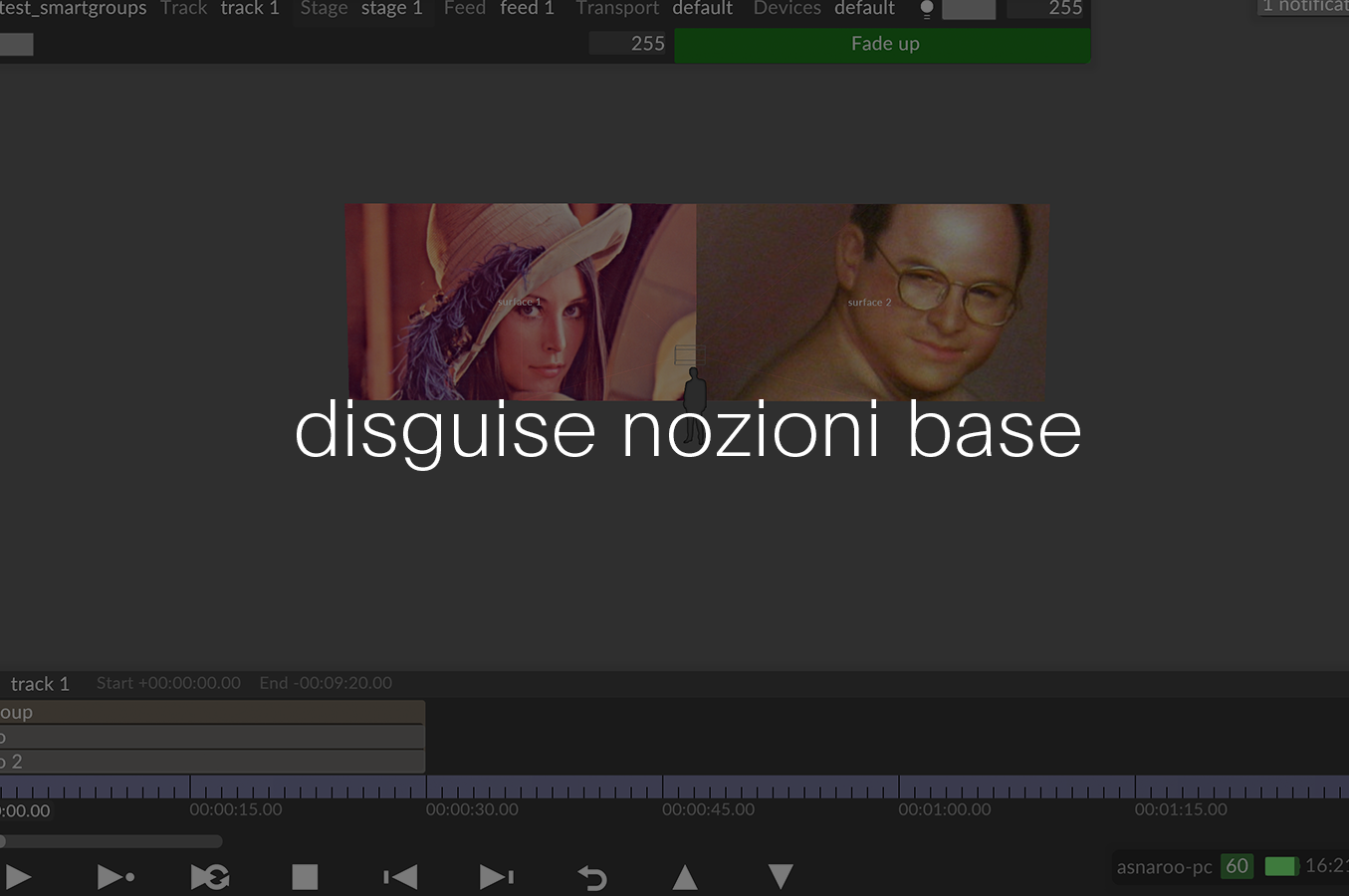

Quella seguente è la quinta di una serie di micro-lezioni volta a focalizzare l’attenzione su elementi differenti del kit di strumenti messo a disposizione da disguise per le produzioni. Nella lezione precedente abbiamo parlato delle caratteristiche principali del video mapping; in questa lezione esamineremo invece la mappatura della proiezione e come viene realizzata.

Tutta la mappatura della proiezione inizia pensando a chi è il pubblico, dov’è posizionato e, soprattutto, quale oggetto si desidera mappare per la proiezione. Molto spesso si tratta di un edificio ma potrebbe anche essere una scultura o una struttura temporanea. Sulla base degli oggetti vengono creati i modelli 3D che costituiranno le fondamenta per la mappatura della proiezione, quindi è importante che siano accurati; per geometrie complesse, è possibile eseguire una scansione laser, che offre una precisione millimetrica per la mappatura.

Una volta completato il modello 3D dell’oggetto da mappare per la proiezione, un processo chiamato mappatura UV converte l’oggetto in una superficie in grado di accettare video, in termini software. La mappatura UV permette di riadattare un contenuto video 2D alla geometria del modello 3D; definisce dove i pixel saranno disposti sull’oggetto, ed è fondamentale per i moderni workflow per la mappatura di proiezione.

Video mapping al Circle of Light, il festival internazionale di Mosca

Una volta completata la mappatura UV, il file obj 3D può essere caricato in un tool di simulazione della proiezione, come il toolkit disguise Designer. Questo strumento consente al team di produzione di simulare la posizione dei proiettori e dell’oggetto mappato e di vedere il comportamento dei pixel della proiezione in questa configurazione. Gli strumenti avanzati includono anche la simulazione del livello di luce per consentire calcoli fotometrici utili a capire quanta luce sarà visibile sull’oggetto durante lo spettacolo di proiezione. A questo punto, i projection designer possono progettare la configurazione ottimale del proiettore scegliendo il tipo di lente e la configurazione di stacking per raggiungere il risultato desiderato.

Ora è il momento della produzione dei contenuti. Il projection design stabilirà la risoluzione complessiva del contenuto necessaria per illuminare l’oggetto e raggiungere un risultato ottimale. In seguito, il contenuto può essere prodotto utilizzando lo stesso file 3D con mappatura UV. Esistono numerosi metodi di produzione dei contenuti, dalla grafica analogica, come lo stop motion, fino agli effetti renderizzati in tempo reale grazie a strumenti per la creazione di contenuti 3D, come Notch. Un buon produttore di contenuti saprà quale strumento utilizzare in base allo storyboard desiderato.

Mapping architetturale della Aachen Cathedral

A prescindere dal metodo di creazione dei contenuti, sarà anche necessario un media server per riprodurli e per gestire l’allineamento dei proiettori. disguise è stato pensato per supportare più editor che lavorano contemporaneamente allo stesso progetto, quindi mentre il team creativo lavora sugli aggiornamenti nel motore di simulazione 3D, la squadra tecnica può realizzare la line up sul posto. La line up è il processo di abbinamento del modello 3D virtuale a quello corrispondente nel mondo reale, incluso lo spostamento dei proiettori virtuali nell’esatta posizione in cui sono stati posti realmente nella venue. Questo processo è supportato da strumenti disguise come QuickCal, oppure come la calibrazione OmniCal che utilizza delle telecamere per individuare la corretta configurazione del proiettore in pochi click.

Una volta completate queste attività, è il momento di mettere in scena lo spettacolo: “affidabilità” è ovviamente la parola chiave. Gli spettacoli di alto profilo spesso richiedono ridondanza e una rete di più server che lavorano tutti insieme per rendere possibile lo spettacolo.